En esta publicación, quiero compartir con ustedes mi proyecto sobre el descubrimiento de “Stable Diffusion”.

Introducción

Stable Diffusion es un modelo avanzado de inteligencia artificial diseñado para la generación y transformación de imágenes. Se basa en técnicas de aprendizaje profundo para procesar y modificar imágenes de forma creativa y realista. Inicialmente diseñado para generar imágenes a partir de descripciones textuales, Stable Diffusion ha evolucionado para aceptar también imágenes como entrada. Esta capacidad hace que Stable Diffusion sea particularmente útil para aplicaciones como el retoque fotográfico, la creación artística asistida por IA y la mejora de la calidad de las imágenes.

Acerca del Proyecto

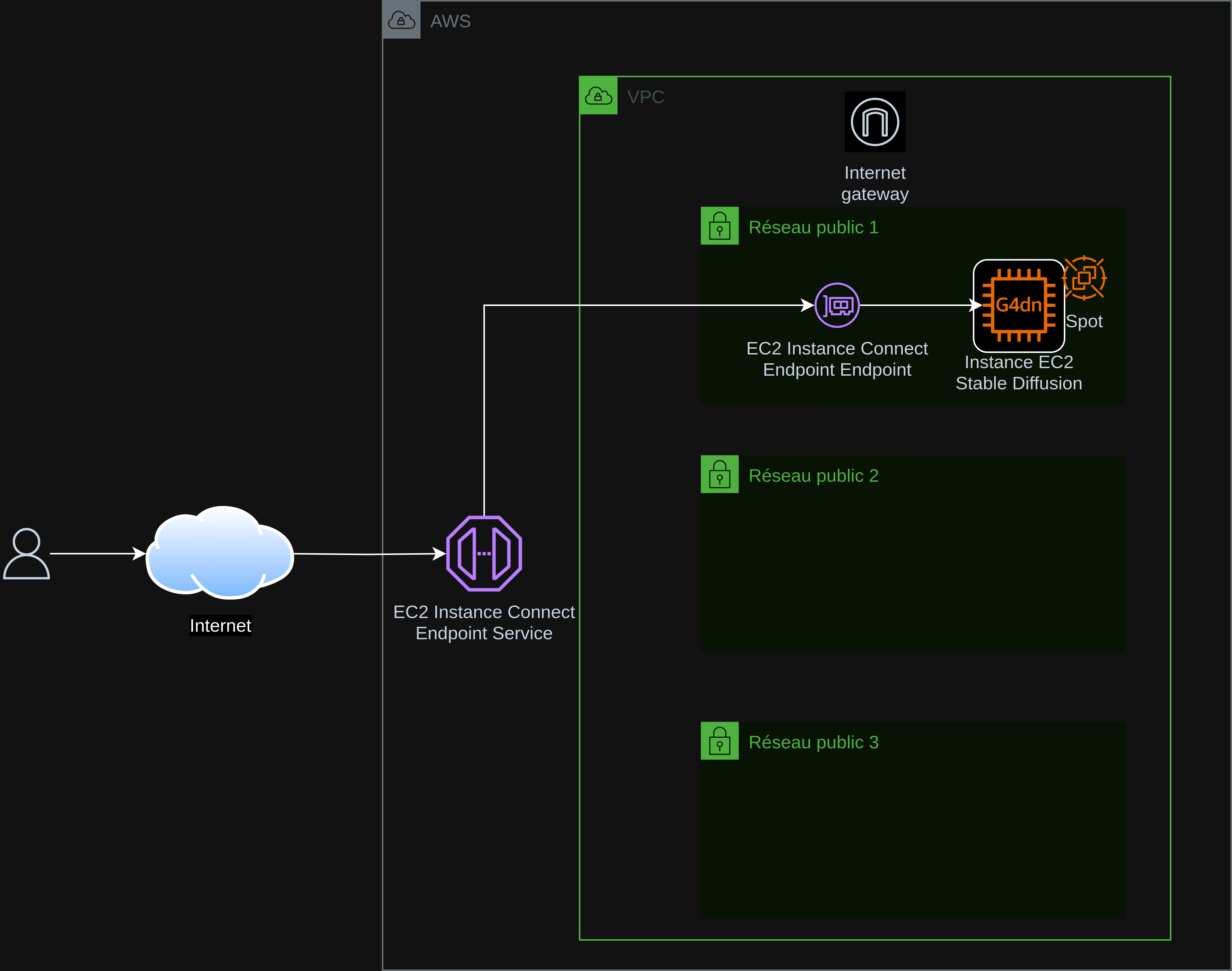

Este proyecto permite desplegar fácilmente “Stable Diffusion XL con Controlnet” en la nube AWS en una EC2. Automatiza la creación y configuración de la infraestructura necesaria para ejecutar “Stable Diffusion XL con Controlnet”. La instalación de Stable Diffusion se realiza manualmente una vez que la EC2 está disponible (con una guía para copiar/pegar). Para limitar los costos de EC2, se utiliza una instancia spot de tipo g4dn.xlarge (1 GPU NVIDIA T4 16 GB GDDR6, 4 vCPU Intel Cascade Lake, 16 GB RAM). El despliegue de Stable Diffusion se realiza con el instalador AUTOMATIC1111.

Arquitectura

Objetivos del Proyecto

- Generación de imágenes : Generar imágenes de alta calidad a partir de un prompt.

- Accesibilidad : Hacer que estas tecnologías sean accesibles y comprensibles.

- Colaboración abierta : Fomentar la colaboración y el intercambio de conocimientos.

> > > > > > > > > > Visita mi proyecto en GitLab haciendo clic aquí < < < < < < < < < <

Este documento ha sido traducido de la versión fr a la lengua es utilizando el modelo claude-3-opus-20240229. Para obtener más información sobre el proceso de traducción, consulte https://gitlab.com/jls42/ai-powered-markdown-translator