I det här inlägget vill jag dela mitt projekt om upptäckten av “Stable Diffusion”.

Introduktion

Stable Diffusion är en avancerad artificiell intelligensmodell utformad för generering och omvandling av bilder. Den bygger på djupinlärningstekniker för att bearbeta och ändra bilder på ett kreativt och realistiskt sätt. Ursprungligen utformad för att generera bilder från textbeskrivningar, har Stable Diffusion utvecklats för att även acceptera bilder som indata. Denna förmåga gör Stable Diffusion särskilt användbar för tillämpningar som bildretuschering, AI-assisterat konstskapande och förbättring av bildkvalitet.

Om projektet

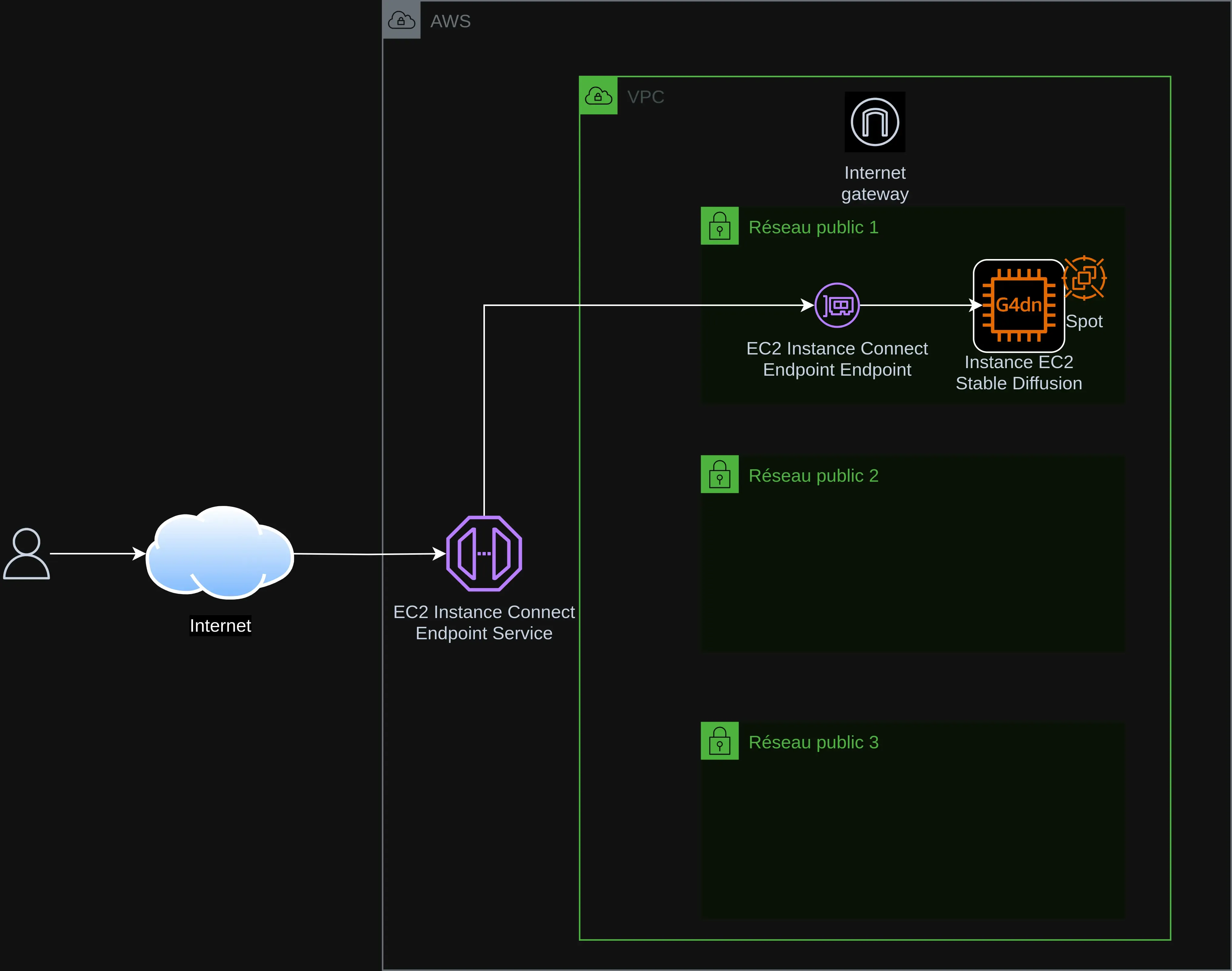

Detta projekt gör det enkelt att distribuera “Stable Diffusion XL med ControlNet” i AWS-molnet på en EC2.

Det automatiserar skapandet och konfigurationen av den infrastruktur som krävs för att köra “Stable Diffusion XL med ControlNet”.

Installation av Stable Diffusion görs manuellt när EC2 är tillgänglig (med en guide att kopiera/klistra in).

För att begränsa EC2-kostnader används en spot-instans av typen g4dn.xlarge (1 GPU NVIDIA T4 16 GO GDDR6, 4 vCPU Intel Cascade Lake, 16 GO RAM).

Driftsättningen av Stable Diffusion utförs med installatören AUTOMATIC1111.

Arkitektur

Projektmål

- Bildgenerering : Generera högkvalitativa bilder från en prompt.

- Tillgänglighet : Göra dessa teknologier åtkomliga och begripliga.

- Öppet samarbete : Uppmuntra samarbete och kunskapsdelning.

Detta dokument har översatts från fr till sv med modellen gpt-5-mini. För mer information om översättningsprocessen, se https://gitlab.com/jls42/ai-powered-markdown-translator