在这篇文章中,我想与大家分享我在"稳定扩散"项目上的发现。

引言

稳定扩散是一个先进的人工智能模型,专为图像生成和转换设计。 它使用深度学习技术创造性和逼真地处理和修改图像。 最初设计用于从文本描述生成图像,稳定扩散已经发展到也可以接受图像输入。 这种能力使得稳定扩散特别适用于如照片修饰、辅助艺术创作和图像质量提升等应用。

关于项目

该项目可以轻松部署"Stable Diffusion XL with Controlnet"至AWS云上的一个EC2中。 它自动化创建并配置运行"Stable Diffusion XL with Controlnet"所需的基础设施。 一旦EC2可用,就可以手动安装Stable Diffusion(附有复制/粘贴的指南)。 为了降低EC2成本,使用了g4dn.xlarge型的spot实例(1个NVIDIA T4 16GB GDDR6 GPU,4个vCPU Intel Cascade Lake,16GB RAM)。 Stable Diffusion的部署使用AUTOMATIC1111的安装器完成。

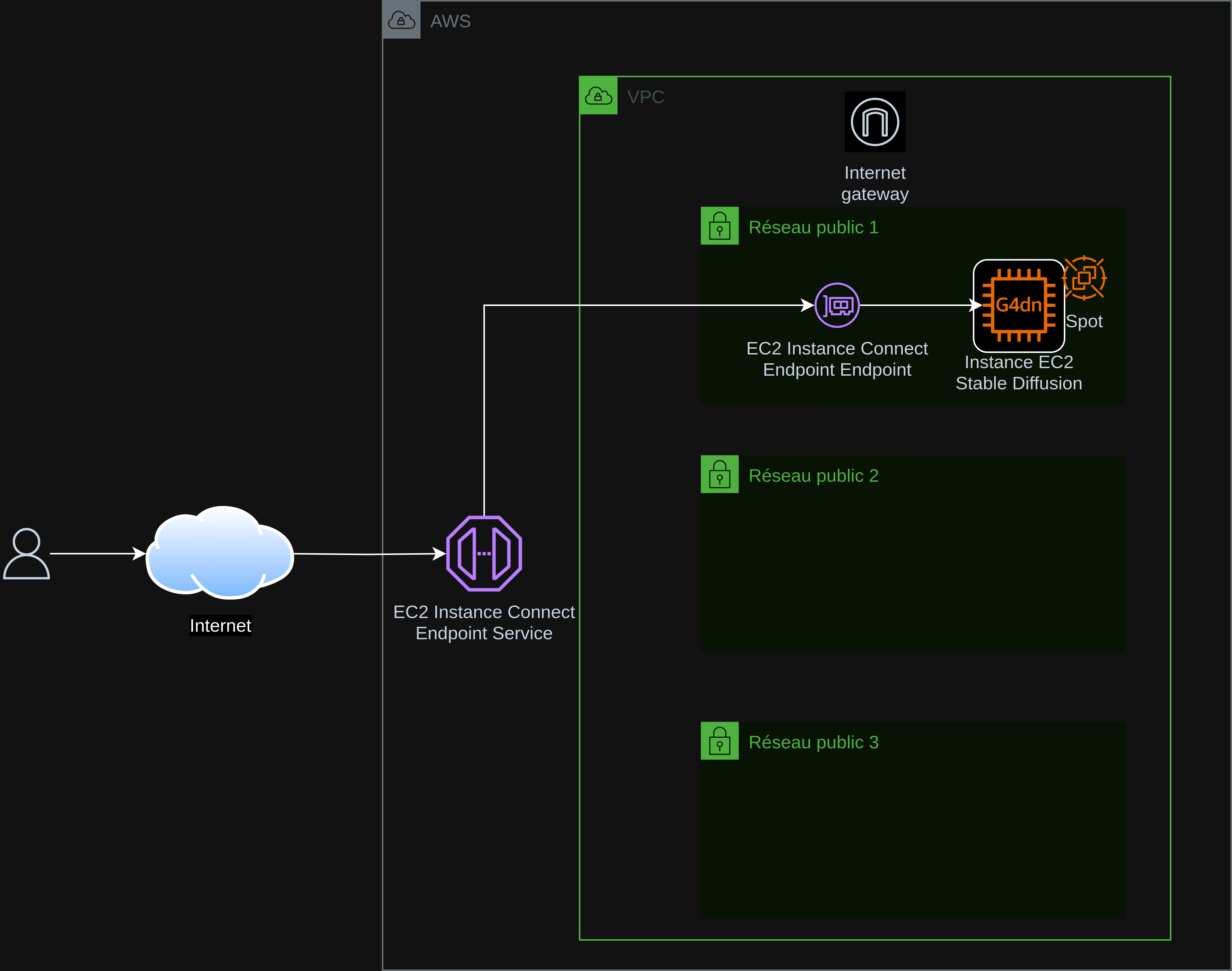

架构

项目目标

- 生成图像:通过提示生成高质量图像。

- 可达性:使这些技术易于理解和使用。

- 开放合作:鼓励合作和知识共享。

> > > > > > > > > > 点击此处访问我的项目在GitLab上的页面 < < < < < < < < < <

这篇文档是由模型 gpt-4-1106-preview 从法文博客版本翻译而来。