Dwie wersje Claude Code opublikowane w dwa dni (v2.1.49 19 lutego, v2.1.50 20 lutego) wprowadzają natywne zarządzanie worktrees dla agentów, sześć poprawek wycieków pamięci oraz nowe hooki enterprise. GitHub Copilot wprowadza trwałą pamięć pozwalającą agentom zapamiętywać konwencje repozytorium między sesjami. ElevenLabs przyspiesza swoje API TTS o 40% i uruchamia system A/B testingu dla agentów głosowych.

Claude Code v2.1.49 i v2.1.50: worktrees, hooki enterprise i zwolniona pamięć

v2.1.49 — 19 lutego 2026

19 lutego 2026 — Anthropic publikuje Claude Code v2.1.49, skupioną na izolacji agentów w worktrees git i nowych możliwościach dla wdrożeń enterprise.

| Funkcja | Szczegóły |

|---|---|

--worktree / -w flag | Uruchamianie Claude bezpośrednio w izolowanym git worktree |

isolation: "worktree" dla subagentów | Subagenci uruchamiają się w tymczasowym dedykowanym worktree git |

background: true w definicjach agentów | Wymuszenie uruchamiania agenta zawsze w tle |

ConfigChange hook event | Wywoływany, gdy zmieniają się pliki konfiguracyjne — audyt bezpieczeństwa enterprise |

| SDK model info rozszerzone | Pola supportsEffort, supportedEffortLevels, supportsAdaptiveThinking |

| MCP OAuth step-up auth | Uwierzytelnianie progresywne i discovery caching |

| Ctrl+F | Zabijanie agentów w tle (dwa naciśnięcia) |

| Sonnet 4.5 1M usunięty z planu Max | Zastąpiony przez Sonnet 4.6 z kontekstem 1M tokenów |

Hook ConfigChange odpowiada na potrzebę enterprise: wykrywać w czasie rzeczywistym każdą zmianę w plikach konfiguracyjnych (CLAUDE.md, settings) dla pipeline’ów audytu i zgodności.

v2.1.50 — 20 lutego 2026

20 lutego 2026 — Claude Code v2.1.50 uzupełnia zestaw o nowe polecenia CLI dla agentów oraz falę poprawek wycieków pamięci.

Nowe funkcje:

| Funkcja | Szczegóły |

|---|---|

WorktreeCreate / WorktreeRemove hooks | Zdarzenia do konfiguracji i demontażu niestandardowego VCS podczas izolacji worktree |

isolation: worktree w definicjach agentów | Agenci deklarują własne izolowane worktree bezpośrednio w swojej definicji |

claude agents CLI | Nowe polecenie do wypisania wszystkich agentów skonfigurowanych w projekcie |

CLAUDE_CODE_DISABLE_1M_CONTEXT | Zmienna środowiskowa do wyłączenia kontekstu 1M tokenów, jeśli konieczne |

| Opus 4.6 fast mode + 1M context | Tryb fast teraz obejmuje pełne okno kontekstu 1M tokenów |

startupTimeout dla serwerów LSP | Konfiguracja timeoutu uruchamiania serwerów LSP |

/extra-usage w VS Code | Nowe polecenie dostępne w sesjach VS Code |

CLAUDE_CODE_SIMPLE rozszerzony: teraz wyłącza narzędzia MCP, załączniki, hooki i ładowanie CLAUDE.md — dla naprawdę minimalistycznego doświadczenia.

6 naprawionych wycieków pamięci:

| Wyciek | Komponent |

|---|---|

| Zadania agentów teammates nie poddawane garbage-collect | Task system |

| Obiekty stanu Task nie usuwane z AppState | AppState |

| Dane diagnostyczne LSP nieczyszczone | LSP integration |

| Output zadań nie zwalniany w długich sesjach | Output buffer |

| Elementy CircularBuffer utrzymywane po cleanup | CircularBuffer |

| ChildProcess / AbortController utrzymywane po wykonaniu shella | Shell execution |

Dodatkowe poprawki: /mcp reconnect już nie blokuje CLI; sesje przywrócone z rozwiązanymi ścieżkami symlink są teraz widoczne; moduły natywne Linux nie ładują się już na glibc < 2.30 (RHEL 8); poprawiono wydajność w trybie headless (-p flag).

GitHub Copilot: trwała pamięć konwencji repozytorium

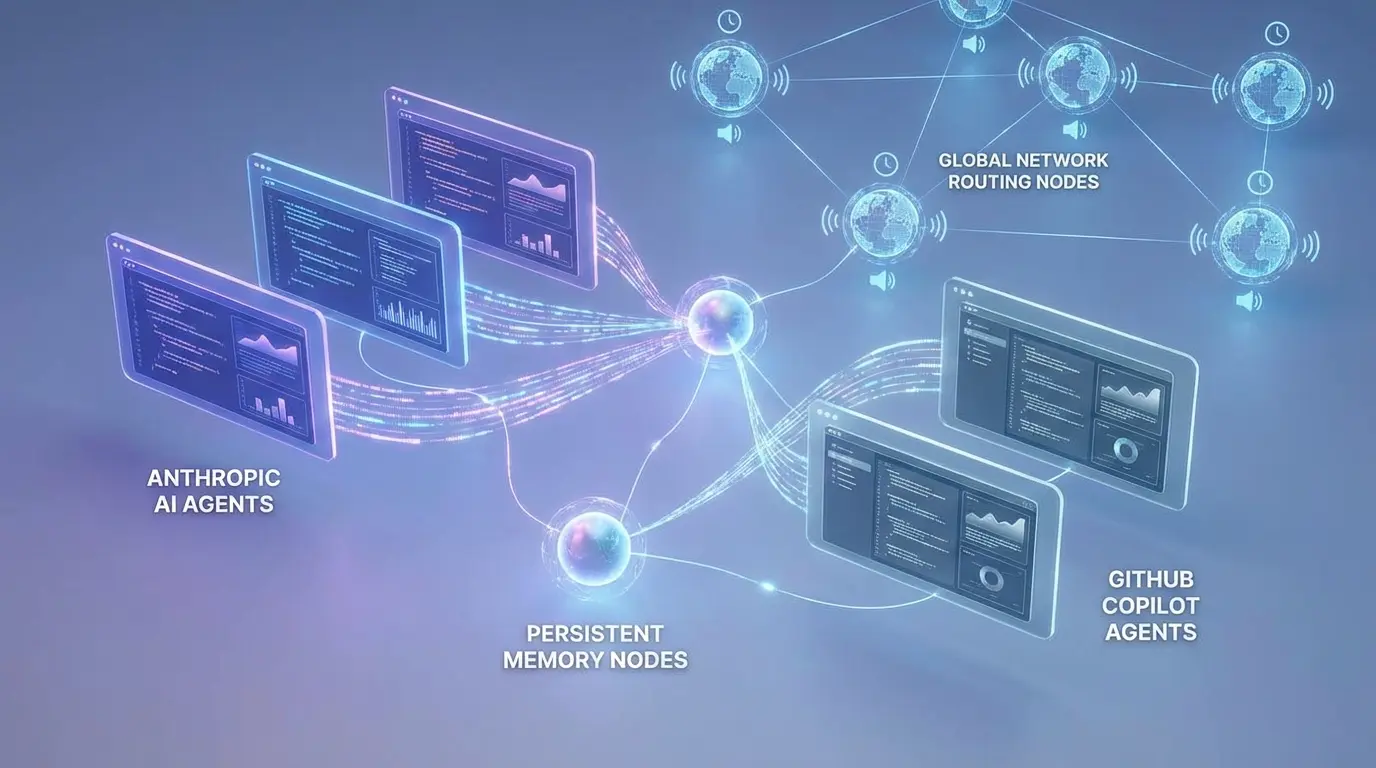

22 lutego 2026 — GitHub ogłasza, że Copilot ma od teraz trwałą pamięć. Agenci dostępni na platformie GitHub — Copilot natywny, Claude i Codex — mogą nauczyć się konwencji, preferencji stylu i praktyk danego repozytorium, a następnie je zapamiętać na kolejne sesje.

W praktyce agent nie musi już za każdym razem przypominać sobie reguł nazewnictwa, szablonów PR czy konwencji commitów projektu — zapamiętuje je po pierwszej interakcji.

Funkcja jest dostępna już teraz w:

- VS Code Insiders

- Copilot CLI

- Copilot coding agent

- Copilot code review

Codex Community Meetups: globalny program uruchomiony

20 lutego 2026 — OpenAI uruchamia program spotkań społecznościowych poświęconych Codex, poprzez sieć ambasadorów. Celem jest umożliwienie deweloperom spotkań lokalnych, tworzenia projektów, porównywania workflowów i wymiany doświadczeń.

Strona developers.openai.com/codex/community/meetups wymienia 20 nadchodzących wydarzeń:

| Miasto | Data |

|---|---|

| Melbourne, Australia | 26 lutego 2026 |

| Toronto, Kanada | 26 lutego 2026 |

| Singapore | 28 lutego 2026 |

| Berlin, Niemcy | 3 marca 2026 |

| Warsaw, Polska | 4 marca 2026 |

| Orlando, FL, USA | 12 marca 2026 |

🔗 Codex Meetups 🔗 Tweet @OpenAIDevs

ElevenLabs: Flash v2.5 40% szybciej i A/B testing dla agentów głosowych

Flash v2.5 — redukcja opóźnienia TTS

20 lutego 2026 — ElevenLabs ogłasza redukcję opóźnienia o 20–40% dla większości międzynarodowych deweloperów korzystających z API Text-to-Speech.

| Parametr | Wartość |

|---|---|

| Redukcja opóźnienia | -20 do -40% dla deweloperów międzynarodowych |

| TTFB (Time to First Byte) | 50ms — bez zmian |

| Mechanizm | Globalnie zoptymalizowane routowanie sieci |

| Modele objęte | Flash v2.5 i Turbo |

TTFB 50ms pozostaje bazą; redukcja dotyczy całkowitego postrzeganego opóźnienia dzięki dodaniu globalnego routingu sieci na istniejącej infrastrukturze.

Experiments w ElevenAgents — A/B testing agentów głosowych

19 lutego 2026 — ElevenLabs wprowadza “Experiments” w ElevenAgents: system A/B testingu służący do optymalizacji wydajności agentów głosowych w warunkach produkcyjnych.

Workflow jest prosty: stworzyć wariant istniejącego agenta, skierować kontrolowaną część ruchu do tego wariantu, zmierzyć wpływ na kluczowe metryki, a następnie wypromować zwycięski wariant.

Śledzone metryki:

- CSAT (zadowolenie klienta)

- Containment rate (współczynnik rozwiązania bez eskalacji)

- Konwersja

Zespoły mogą testować różne konfiguracje: strukturę prompta, logikę workflow, głos, osobowość. Podejście pozwala poprawiać wyniki w sposób data-driven zamiast intuicyjnego.

Drobne aktualizacje

1. rocznica Claude Code (22 lutego) — Boris Cherny (@bcherny), product lead Claude Code w Anthropic, świętuje pierwszą rocznicę narzędzia spotkaniem na żywo. Claude Code zaczynał jako projekt hackathonowy. 🔗 Tweet @bcherny

Codex CLI v0.104.0 (18 lutego) — Obsługa zmiennych środowiskowych WS_PROXY / WSS_PROXY do proxyowania websocketów w środowiskach z proxy sieciowym, powiadomienia przy archiwizacji/odarchiwowaniu wątków oraz odrębne ID zatwierdzeń dla wielu zatwierdzeń w jednym przepływie wykonania shella. 🔗 Codex Changelog

Codex App 26.217 (17 lutego) — Drag-and-drop do zmiany kolejności wiadomości w kolejce, ostrzeżenie gdy wybrany model jest degradacją, oraz ulepszenie fuzzy file search. 🔗 Codex Changelog

Copilot CLI: skill “Make Contribution” (21 lutego) — Nowy skill agenta dla Copilot CLI: automatycznie znajduje wytyczne dotyczące wkładu do repozytorium i działa zgodnie z nimi przed otwarciem PR (szablony, konwencje kodu, proces review). Dostępny jako open source w repozytorium awesome-copilot. 🔗 SKILL.md

Co to oznacza

Obie wersje Claude Code opublikowane w tym tygodniu (v2.1.49 i v2.1.50) tworzą spójną całość: Anthropic buduje infrastrukturę dla agentów wielozespołowych w izolowanych środowiskach. Hooki WorktreeCreate/WorktreeRemove pozwalają zespołom integrować własne systemy zarządzania kodem (nie tylko git), podczas gdy naprawa sześciu wycieków pamięci adresuje bezpośrednio długotrwałe sesje agentów autonomicznych — kluczowy punkt dla produkcyjnych workflowów.

Trwała pamięć GitHub Copilot zmienia wartość dodaną agentów kodu: z “asystenta odpowiadającego na pytania” w kierunku “współpracownika, który zna twój projekt”. Umiejętność zapamiętywania konwencji między sesjami redukuje główną tarcie przy adopcji agentów w zespołach z ustalonymi standardami.

ElevenLabs kontynuuje dojrzałość infrastruktury dla agentów głosowych na dużą skalę: redukcja opóźnienia o 40% i natywny A/B testing w ElevenAgents to narzędzia, których zespoły produktowe potrzebują, by przejść od prototypu do wdrożenia produkcyjnego.

Źródła

- CHANGELOG Claude Code v2.1.49-2.1.50

- Copilot trwała pamięć — @github

- Codex Community Meetups — @OpenAIDevs

- Codex Meetups — Strona oficjalna

- ElevenLabs Flash v2.5 + Experiments — @elevenlabsio

- 1. rocznica Claude Code — @bcherny

- Codex CLI 0.104.0 + App 26.217 Changelog

- Copilot “Make Contribution” skill — awesome-copilot

Ten dokument został przetłumaczony z wersji fr na język pl przy użyciu modelu gpt-5-mini. Aby uzyskać więcej informacji na temat procesu tłumaczenia, zobacz https://gitlab.com/jls42/ai-powered-markdown-translator