Deux versions de Claude Code publiées en deux jours (v2.1.49 le 19 février, v2.1.50 le 20 février) apportent une gestion native des worktrees pour les agents, six corrections de fuites mémoire, et de nouveaux hooks d’entreprise. GitHub Copilot introduit une mémoire persistante qui permet aux agents de retenir les conventions d’un dépôt entre les sessions. ElevenLabs accélère son API TTS de 40% et lance un système d’A/B testing pour les agents vocaux.

Claude Code v2.1.49 et v2.1.50 : worktrees, hooks enterprise et mémoire libérée

v2.1.49 — 19 février 2026

19 février 2026 — Anthropic publie Claude Code v2.1.49, centré sur l’isolation des agents dans des worktrees git et de nouvelles capacités pour les déploiements enterprise.

| Fonctionnalité | Détail |

|---|---|

--worktree / -w flag | Démarrer Claude directement dans un git worktree isolé |

isolation: "worktree" pour subagents | Les subagents s’exécutent dans un worktree git temporaire dédié |

background: true dans définitions agents | Forcer un agent à toujours s’exécuter en tâche d’arrière-plan |

ConfigChange hook event | Déclenché quand les fichiers de configuration changent — audit sécurité enterprise |

| SDK model info étendu | Champs supportsEffort, supportedEffortLevels, supportsAdaptiveThinking |

| MCP OAuth step-up auth | Auth progressive et discovery caching |

| Ctrl+F | Tuer les agents en arrière-plan (deux pressions) |

| Sonnet 4.5 1M retiré du Max plan | Remplacé par Sonnet 4.6 avec contexte 1M tokens |

Le hook ConfigChange répond à un besoin enterprise : détecter en temps réel toute modification des fichiers de configuration (CLAUDE.md, settings) pour les pipelines d’audit et de conformité.

v2.1.50 — 20 février 2026

20 février 2026 — Claude Code v2.1.50 complète le tableau avec de nouvelles commandes CLI pour les agents et une vague de corrections de fuites mémoire.

Nouvelles fonctionnalités :

| Fonctionnalité | Détail |

|---|---|

WorktreeCreate / WorktreeRemove hooks | Événements pour configurer et démonter un VCS custom lors de l’isolation worktree |

isolation: worktree dans définitions agents | Les agents déclarent leur propre isolation worktree directement dans leur définition |

claude agents CLI | Nouvelle commande pour lister tous les agents configurés dans le projet |

CLAUDE_CODE_DISABLE_1M_CONTEXT | Variable d’environnement pour désactiver le contexte 1M tokens si nécessaire |

| Opus 4.6 fast mode + 1M context | Le fast mode inclut maintenant la fenêtre de contexte 1M tokens complète |

startupTimeout pour LSP servers | Configurer le timeout de démarrage des serveurs LSP |

/extra-usage dans VS Code | Nouvelle commande disponible dans les sessions VS Code |

CLAUDE_CODE_SIMPLE étendu : désactive désormais les outils MCP, les attachements, les hooks et le chargement de CLAUDE.md — pour une expérience vraiment minimale.

6 fuites mémoire corrigées :

| Fuite | Composant concerné |

|---|---|

| Tâches d’agents teammates non garbage-collectées | Task system |

| Task state objects non supprimés de AppState | AppState |

| Données LSP diagnostiques non nettoyées | LSP integration |

| Task output non libéré en sessions longues | Output buffer |

| Items CircularBuffer retenus après cleanup | CircularBuffer |

| ChildProcess / AbortController retenus après exécution shell | Shell execution |

Corrections supplémentaires : /mcp reconnect ne gèle plus le CLI ; les sessions reprises avec des chemins symlink résolus sont maintenant visibles ; les modules natifs Linux ne chargent plus sur glibc < 2.30 (RHEL 8) ; performances améliorées en mode headless (-p flag).

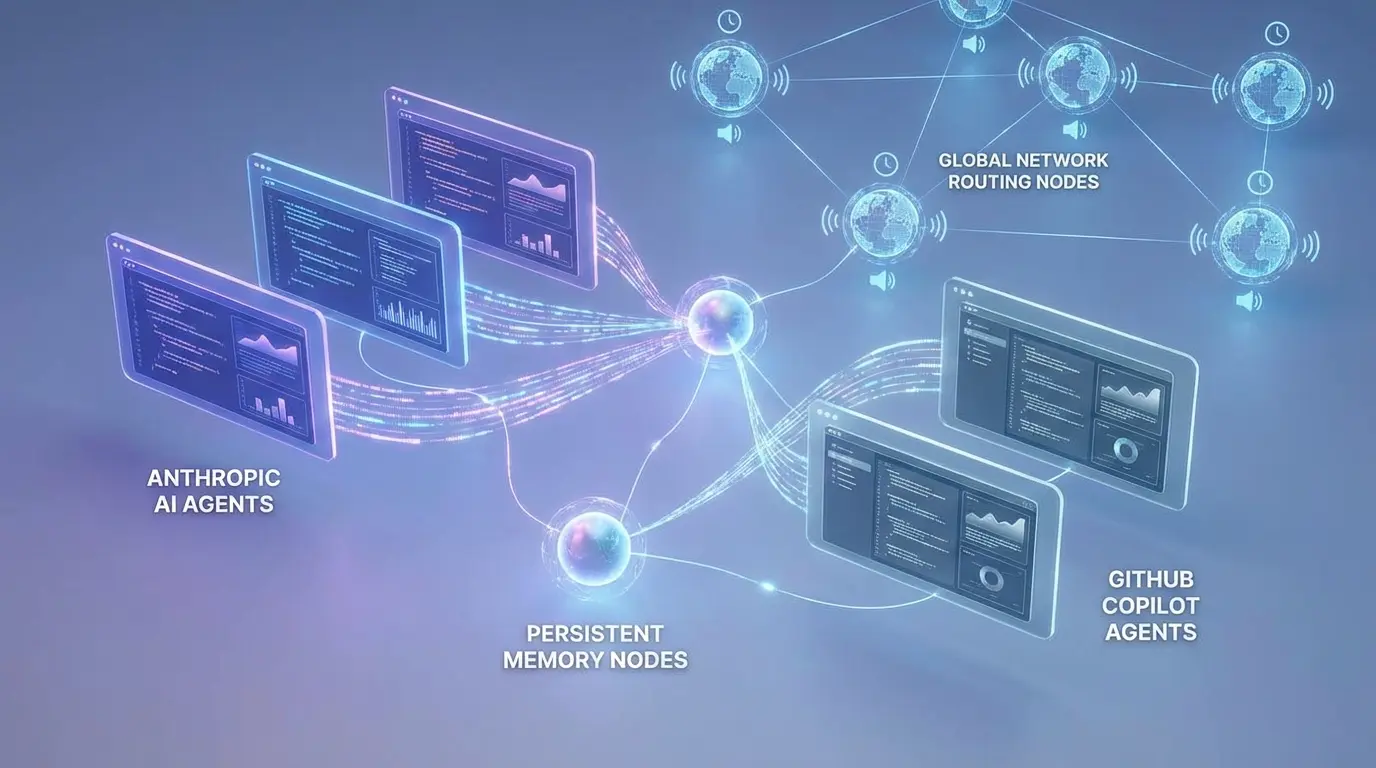

GitHub Copilot : mémoire persistante des conventions de dépôt

22 février 2026 — GitHub annonce que Copilot dispose désormais d’une mémoire persistante. Les agents présents sur la plateforme GitHub — Copilot natif, Claude, et Codex — peuvent apprendre les conventions, préférences de style et pratiques d’un dépôt, puis s’en souvenir lors des sessions suivantes.

Concrètement, un agent n’a plus besoin qu’on lui rappelle à chaque session les règles de nommage, les templates de PR ou les conventions de commit du projet — il les mémorise après la première interaction.

La fonctionnalité est disponible dès maintenant dans :

- VS Code Insiders

- Copilot CLI

- Copilot coding agent

- Copilot code review

Codex Community Meetups : programme mondial lancé

20 février 2026 — OpenAI lance un programme de meetups communautaires dédiés à Codex, via son réseau d’ambassadeurs. L’objectif : permettre aux développeurs de se retrouver localement pour créer des projets, comparer leurs workflows et échanger sur leurs usages.

La page developers.openai.com/codex/community/meetups liste 20 événements à venir :

| Ville | Date |

|---|---|

| Melbourne, Australie | 26 février 2026 |

| Toronto, Canada | 26 février 2026 |

| Singapore | 28 février 2026 |

| Berlin, Allemagne | 3 mars 2026 |

| Warsaw, Pologne | 4 mars 2026 |

| Orlando, FL, USA | 12 mars 2026 |

🔗 Codex Meetups 🔗 Tweet @OpenAIDevs

ElevenLabs : Flash v2.5 40% plus rapide et A/B testing pour agents vocaux

Flash v2.5 — réduction de latence TTS

20 février 2026 — ElevenLabs annonce une réduction de latence de 20 à 40% pour la majorité des développeurs internationaux utilisant l’API Text-to-Speech.

| Paramètre | Valeur |

|---|---|

| Réduction de latence | -20 à -40% pour développeurs internationaux |

| TTFB (Time to First Byte) | 50ms — inchangé |

| Mécanisme | Routage réseau global optimisé |

| Modèles concernés | Flash v2.5 et Turbo |

Le TTFB de 50ms reste la baseline ; la réduction s’applique à la latence totale perçue grâce à l’ajout d’un routage réseau global sur l’infrastructure existante.

Experiments dans ElevenAgents — A/B testing agents vocaux

19 février 2026 — ElevenLabs introduit “Experiments” dans ElevenAgents : un système d’A/B testing pour optimiser les performances des agents vocaux en conditions réelles.

Le workflow est simple : créer une variante de l’agent existant, router une portion contrôlée du trafic vers cette variante, mesurer l’impact sur les métriques clés, puis promouvoir la variante gagnante.

Métriques suivies :

- CSAT (satisfaction client)

- Containment rate (taux de résolution sans escalade)

- Conversion

Les équipes peuvent tester des configurations variées : structure du prompt, logique de workflow, voix, personnalité. L’approche permet d’améliorer les résultats de façon data-driven plutôt qu’intuitive.

Mises à jour mineures

1er anniversaire Claude Code (22 fév.) — Boris Cherny (@bcherny), chef de produit Claude Code chez Anthropic, célèbre le premier anniversaire de l’outil avec un rassemblement en personne. Claude Code a lui-même démarré comme projet hackathon. 🔗 Tweet @bcherny

Codex CLI v0.104.0 (18 fév.) — Support des variables d’environnement WS_PROXY / WSS_PROXY pour le proxying websocket en environnement proxy réseau, notifications lors de l’archivage/désarchivage de threads, et IDs d’approbation distincts pour les approbations multiples dans un seul flux d’exécution shell. 🔗 Codex Changelog

Codex App 26.217 (17 fév.) — Drag-and-drop pour réordonner les messages en file d’attente, avertissement quand le modèle sélectionné est rétrogradé, et amélioration de la fuzzy file search. 🔗 Codex Changelog

Copilot CLI : “Make Contribution” skill (21 fév.) — Nouveau skill agent pour Copilot CLI : il trouve automatiquement les guidelines de contribution d’un dépôt et les suit avant d’ouvrir une PR (templates, conventions de code, processus de review). Disponible en open source sur le dépôt awesome-copilot. 🔗 SKILL.md

Ce que ça signifie

Les deux versions de Claude Code publiées cette semaine (v2.1.49 et v2.1.50) forment un tout cohérent : Anthropic construit l’infrastructure pour les agents multi-équipes dans des environnements isolés. Les WorktreeCreate/WorktreeRemove hooks permettent aux équipes d’intégrer leurs propres systèmes de gestion de code (pas seulement git), tandis que la correction des 6 fuites mémoire s’adresse directement aux sessions longues des agents autonomes — un point critique pour les workflows de production.

La mémoire persistante de GitHub Copilot change la proposition de valeur des agents de code : passer de “assistant qui répond à des questions” à “collaborateur qui connaît votre projet”. La capacité à mémoriser les conventions inter-sessions réduit la friction principale de l’adoption des agents dans des équipes avec des standards établis.

ElevenLabs continue de mûrir son infrastructure pour les agents vocaux à l’échelle : la réduction de latence de 40% et l’A/B testing natif dans ElevenAgents sont des outils que les équipes produit attendent pour passer du prototype au déploiement en production.

Sources

- CHANGELOG Claude Code v2.1.49-2.1.50

- Copilot mémoire persistante — @github

- Codex Community Meetups — @OpenAIDevs

- Codex Meetups — Page officielle

- ElevenLabs Flash v2.5 + Experiments — @elevenlabsio

- 1er anniversaire Claude Code — @bcherny

- Codex CLI 0.104.0 + App 26.217 Changelog

- Copilot “Make Contribution” skill — awesome-copilot

本文件已使用 gpt-5-mini 模型从法语(fr)翻译为中文(zh)。有关翻译过程的更多信息,请参阅 https://gitlab.com/jls42/ai-powered-markdown-translator